今日のデータセンターは、AIとクラウドコンピューティングの進化に牽引され、かつてないスピードと規模で世界の経済と社会を動かす中核エンジンとなっています。かつてPCやスマートフォンが半導体産業の黄金時代を築いたとすれば、AIを核心とするデータセンターは、まさに新たな「チップの時代」を切り開いています。これは単なる漸進的な進化ではなく、産業全体を根底から覆す変革であり、データセンター向けの半導体市場は、前例のない速さで数兆ドル規模の巨大市場へと拡大しようとしています。

AIが牽引する「データセンターの芯時代」

算力競争の最前線:AI投資の激増

生成AIの爆発的な普及は、この変革の最も強力な触媒です。業界予測によれば、データセンターへの投資においてAI関連の設備投資が非AI支出を上回り、全体の約75%を占めています。2025年にはこの数字が4,500億ドルを超えると予測されています。AIサーバーの成長は目覚ましく、計算サーバー全体に占める割合は2020年の数%から2024年には10%以上に増加。基盤モデルの学習、推論、そしてカスタムチップの革新を背景に、世界のテック大手は激しい「算力(計算能力)の軍備競争」に突入しています。マイクロソフト、Google、Metaといった主要企業が毎年数百億ドルを投じる中、中小企業もこの流れに急速に追随。彼らは、将来の競争優位性がインフラの規模とチップレベルの差別化に直結することを深く理解しているからです。

半導体市場を席巻するデータセンター需要

この爆発的な成長は、前例のない半導体需要を生み出しています。Yole Groupの分析によると、データセンター半導体市場は2024年から拡大を加速し、2030年には4,930億ドルに達すると予測されています。この時点で、データセンター半導体は半導体市場全体の50%以上を占め、その複合年間成長率(2025年~2030年)は半導体業界全体のほぼ2倍に。これは、AI、クラウドコンピューティング、そしてハイパースケールインフラの需要によって推進される巨大な転換を反映しています。

データセンターを支えるキーテクノロジー群

GPUとASIC:AI処理の主役たち

まず、GPUはAI集約型ワークロードの複雑化と処理要件の増加に伴い、最も速い成長を続け、引き続きデータセンター半導体の主流を占めるでしょう。NVIDIAは、その強力なGPUエコシステムを武器に、従来のチップ設計会社から、フルスタックのAIおよびデータセンターソリューションプロバイダーへと変貌を遂げています。同社のコア製品であるBlackwell GPUは、TSMCの最先端4nmプロセスを採用し、この分野で主導的な地位を維持しています。

NVIDIAの市場支配に対抗するため、AWS、Google、Azureなどの大手クラウドサービスプロバイダーは、AWSのGravitonチップのように独自のAIアクセラレーションチップを開発し、カスタムストレージやネットワークハードウェアの革新を進めています。これらの技術開発により、AIチップ分野、特に推論と学習の局面での競争が激化しており、AIチップの性能差別化が企業の競争力の核となっています。このようなGPUとASICの並行開発は、データセンターコンピューティングの新たな主流となりつつあります。

HBM:データ処理のボトルネックを解消する超高速メモリ

AIモデルの規模が指数関数的に拡大するにつれて、従来のメモリ帯域幅は計算能力向上の最大のボトルネックとなっています。そこで登場したのが、高帯域幅メモリ(HBM)です。革新的な3Dスタッキング技術により、メモリ帯域幅と容量を飛躍的に向上させ、AIおよび高性能コンピューティング(HPC)サーバーの必須コンポーネントとなりました。Archive market researchの調査レポートによると、HBM市場は爆発的な成長を遂げており、2025年には38.16億ドルに達し、2025年から2033年までの複合年間成長率(CAGR)は68.2%に達すると予測されています。HBMの急速な成長は、ストレージ半導体市場における新たな強力な成長点となっています。

AIチップセットにおけるHBM市場にはいくつかの重要なトレンドが見られます。まず、単一スタックで8GBを超えるモジュールが一般的になり、より複雑なAIモデルからの高速データ処理への切迫した需要が背景にあります。次に、低消費電力HBM設計の革新が促されており、電力効率が重要な要素となっています。さらに、HBMをAIアクセラレータに直接統合することがますます一般的になり、遅延を最小限に抑え、全体的な性能を向上させています。標準化されたインターフェースの登場は、システム統合を簡素化し、AIシステムの市場投入時間を短縮しています。最後に、シリコン貫通ビア(TSV)などの先進的なパッケージング技術の採用により、高密度で効率的なHBMスタックが可能になり、エッジAIの需要増大が、組み込みシステムやモバイルデバイスなどの小型アプリケーション向けに費用対効果の高いHBMソリューションの開発を推進しています。

世界のHBM市場の主要なプレーヤーは、SK Hynix、Samsung、Micron Technologyであり、国内(中国)にもいくつかのメーカーが存在します。中でも、SK HynixとSamsungが世界のHBM供給の90%以上を占めています。Micron Technologyは、HBM3Eを量産する最初の米国企業となり、その製品はNVIDIAのH200 GPUに採用されています。

DPUとネットワークASIC:効率的なデータ転送の要

大量のデータが流れるAI時代において、効率的なネットワーク相互接続は極めて重要です。データ処理ユニット(DPU)と高性能ネットワークASICの台頭は、CPUとGPUからネットワーク処理タスクをオフロードし、トラフィック管理を最適化することで、より多くの計算リソースを解放することを目的としています。さらに、DPUはセキュリティ、スケーラビリティ、エネルギー効率、そして長期的なコスト効率の面でも大きな優位性を持っています。

次世代データセンターを創る革新的技術

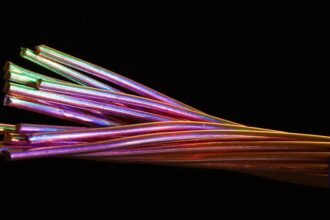

シリコンフォトニクスとCPO:光が拓く高速通信

データセンター内部のデータ伝送は、従来の銅線接続から光インターコネクトへと急速に移行しています。シリコンフォトニクス技術、特にコパッケージドオプティクス(CPO)は、高速・低消費電力インターコネクトの課題を解決する鍵となっています。CPOは光学エンジンをCPU/GPU/ASICなどの計算チップのパッケージ内部に直接統合することで、電気信号の伝送経路を大幅に短縮し、遅延を低減し、エネルギー効率を著しく向上させます。Marvell、NVIDIA、Broadcomなどの業界大手は積極的にこの分野に投資しており、2030年までに数十億ドル規模の収益を生み出すと予測されています。

今年1月、MarvellはカスタムAIアクセラレータ向けの画期的なコパッケージド光学アーキテクチャを発表しました。CPOを統合したXPUは、ラック内のXPU密度を数十個から複数のラックにわたる数百個に増強することで、AIサーバーの性能を向上させます。

薄膜ニオブ酸リチウム(TFLN)変調器は、光通信分野におけるもう一つの画期的な進展です。これは、高速ニオブ酸リチウム変調器技術とシリコンフォトニクスのスケーラビリティを組み合わせたものです。TFLN変調器は、超高帯域幅(70GHz以上)、極めて低い挿入損失(2dB未満)、コンパクトなサイズ、低駆動電圧(2V未満)、およびCMOS製造プロセスとの互換性といった特性を備えています。これらの特性により、1チャンネルあたり200Gbpsの変調器や、データセンター内部の高性能接続を実現するのに理想的です。

CPOは、プラグイン可能なソリューションの「電気インターフェースのボトルネック」を直接解決し、電力と帯域幅の面で画期的な飛躍を可能にします。これは「メモリウォール」に続く「電の壁」を突破するものとして、増加する電力密度への対応や、データセンター内部および間のより効率的なデータ伝送にとって極めて重要です。CPOは、より長距離かつ高密度のXPU間接続を可能にし、データセンターアーキテクチャのさらなる疎結合化を促進し、計算リソースのより柔軟な分散を可能にします。

先進パッケージング:チップ設計の自由度を最大化

CPOは、先進パッケージング技術がデータセンターに適用される一例に過ぎません。3Dスタッキングやチップレットなどの技術を通じて、半導体メーカーは異なる機能を持つチップ(計算、メモリ、I/Oなど)を同一の基板上に統合し、より強力で柔軟なヘテロジニアスコンピューティングプラットフォームを構築できます。この「レゴブロック型」のチップ設計方法は、従来のムーアの法則の物理的限界を突破するだけでなく、カスタムチップにより大きな柔軟性をもたらします。

DC電源:効率を極めるデータセンター設計

AIワークロードが計算能力の要求を激増させるにつれて、データセンターの電力密度も急上昇し、従来の交流(AC)給電方式は大きな課題に直面しています。現代のAIラックの電力要求は、過去の20キロワットから2023年には36キロワットに跳ね上がり、2027年には50キロワットに達すると予測されています。NVIDIAは、600キロワットのラックアーキテクチャさえ提案しており、これにより従来のAC-DC変換による複数回のエネルギー損失が容認できないレベルに達しています。そのため、データセンターは直流(DC)電源の採用へとシフトしており、これはエネルギー効率を向上させる新たなパラダイムとなっています。DC配電は、不要なAC-DC変換ステップを排除することで、エネルギー損失を削減し、全体的な効率を向上させます。

まとめ:AIが描く半導体とデータセンターの未来

データセンターは、AIの爆発的な進化を背景に、半導体産業における新たな成長の牽引役としてその存在感を増しています。GPU、HBM、DPUといった主要コンポーネントの進化に加え、シリコンフォトニクス、先進パッケージング、そしてDC電源への移行といった革新的な技術が、今後のデータセンターの性能と効率を劇的に向上させるでしょう。

この「芯」の時代は、日本企業にとっても大きなビジネスチャンスと挑戦をもたらします。高性能半導体の設計・製造、新たな冷却技術、そしてエネルギー効率の高いデータセンターインフラの構築など、多岐にわたる分野での技術革新が求められます。世界的な算力競争が激化する中で、データセンター半導体市場の動向は、今後も私たちの生活や経済に直接的な影響を与え続ける重要なトレンドとなるでしょう。

元記事: 36氪_让一部分人先看到未来

Photo by Pachon in Motion on Pexels